今天为大家分享李凤华、李晖、邱卫东、牛犇、邹德清等编写的“隐私计算研究进展、现状及趋势”,收录在《中国信息处理发展报告(2021)》中。

一个新的理论从创立到得到社会各界认可,往往需要较长的时间,克服各种困难,不断迭代演进,逐步发展完善,隐私计算还需要做大量的理论和技术探索研究。根据大数据安全和隐私计算技术的发展,中国中文信息学会大数据安全和隐私计算专业委员会 2018 年因势而成立,隐私计算是本专委会致力于推动的重要学术工作。经过几年来隐私计算的研究与发展,隐私计算得到学术界和产业界的认同,因此本专委会(李凤华、李晖、邱卫东、牛犇、邹德清等)从 2021 年开始撰写隐私计算研究进展报告。

12.1.研究背景与意义

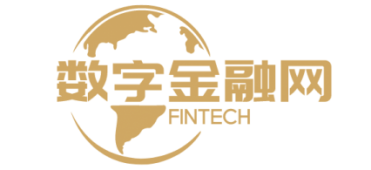

随着通信技术、网络技术和计算技术的持续演进和广泛应用,形成了包含因特网、移动互联网、物联网、卫星通信网、卫星互联网、天地一体化网络等异构网络的泛在互联环境。泛在互联环境具有开放性、异构性、移动性、动态性等特性,并与边缘计算、云计算等技术深度融合。在性能越来越强的智能终端支持下,泛在互联环境能够提供不同层次的多样化和个性化的信息服务,实现了“万物互联、智慧互通”,极大地推动人类社会发展,对社会、政治、经济、文化等领域有重要战略意义。在泛在互联环境下,信息广泛传播,呈爆炸式增长,电商、物流、支付、导航、社交等信息服务新业态不断涌现,大型互联网公司在服务用户的过程中通过采集、存留、交换、衍生等手段积累了海量数据,数据频繁跨境、跨系统、跨生态圈交互在信息服务的推动下成为常态,如图 1 所示。这些加大了隐私信息在不同信息系统中有意或无意留存的可能性,隐私信息保护短板效应、隐私侵权追踪溯源难等问题也随之而来,个人信息保护面临的问题与日俱增。

针对上述问题,各国政府部门展现出高度重视的姿态。例如,欧盟颁布的《通用数据保护条例》(General Data Protection Regulation,GDPR)强化了对被遗忘权、删除权的要求;我国颁布的《中华人民共和国民法典》将隐私保护纳入法律规定;中央网信办、工业和信息化部、公安部、市场监管总局四部门联合发布《关于开展App违法违规收集使用个人信息专项治理的公告》规范个人信息采集;2021 年 11 月 1 日,《中华人民共和国个人信息保护法》生效实施,明确了个人具备对个人信息处理的知情权、删除权等,个人信息的权益保障已成为国家战略。个人信息保护面临的诸多具体问题包括:缺乏体系化标准规范与指引,App过度采集个人信息,后台隐私数据越权使用与个人画像,个人信息过度留存,生态圈之间信息共享缺乏延伸控制和迭代按需脱敏,多副本留存和保护短板效应凸显,删除权无法保障,数据交易和流动缺少有效监管手段,数据利用、脱敏、删除的合规评测缺少技术支撑等等。为解决这些问题,学者们针对某一环节的不同应用场景提出了诸多解决方案,这些方案虽能在特定应用场景、特定假设条件下解决特定的隐私信息泄露问题,但在面对“万物互联”场景下尚未提供体系化的保护能力。个人信息保护的核心是隐私保护,隐私保护的根本问题是需要体系化的理论和关键技术以实现全生命周期的隐私信息管控,隐私信息管控的核心技术是个人敏感信息的分类分级和延伸控制,并在此基础上实现个人信息使用的知情权、脱敏、删除权/被遗忘权、流转管控和监管五位一体,迫切需要体系化、完善的隐私计算理论。

12.2.隐私计算内涵与研究范畴

12.2.1. 相关领域的学术内涵

与隐私计算相关领域的概念内涵,目前学者有不同的理解,为了促进隐私计算的健康发展,本报告首先对相关概念内涵进行简要说明。

【1】个人信息与隐私信息:个人信息是指以电子或者其他方式记录的能够单独或者与其他信息结合识别特定自然人的各种信息,包括自然人的姓名、出生日期、身份证件号码、生物识别信息、住址、电话号码、电子邮箱、健康信息、行踪信息等。隐私信息是指个人信息中的敏感信息,是不想被非授权人知道的信息,是个人信息记录中的标识符、准标识符和敏感属性的集合。隐私反映了标识符、准标识符和敏感属性的关联关系。

【2】隐私泄露与隐私保护:隐私泄露分为两种情况,一是在有边界信息系统内隐私信息被非授权访问造成的泄露,二是在信息交换过程中未脱敏或脱敏强度没有达到要求而造成的泄露;对应的隐私保护也分为两种情况,一是保障信息不受损失前提下隐私不被非授权者获取及处理,我们称之为隐私防护;二是在隐私交换与处理过程中信息接收者得到隐私的信息量要小于信息发送方的同一隐私的信息量,使接收方不能完全获知发送方的真实信息,我们称为隐私脱敏。例如,去标识化使敏感信息与信息主体失去关联,也是信息量损失的形式之一。

【3】数据安全:主要指保证数据的机密性、完整性、不可否认性等,保证被保护的数据具有可恢复性,即信息的无损性。大多使用密码学、访问控制等方面的技术实施。

【4】密码学:主要研究范畴是保护信息的机密性、完整性和不可否认性的理论及应用技术。机密性的本质是信息没有损失,在共享范围内所有人得到的内容是相同的,主要用于防止在知悉范围之外的人获得被保护的信息;机密性的研究范畴是面向数据安全、传输安全等场景,并不特定针对隐私保护,在特定场景下可用于隐私防护。完整性是防止信息被篡改,其研究内涵与隐私保护没有任何关系。不可否认性可用于确定数据来源、交易等场景的真实性,还可用于隐私全生命保护过程中的审计取证。

【5】访问控制:主要用于控制信息知悉范围,即确认主体访问客体的权限,不涉及信息内容的变更,但可决定主体访问信息的全部或部分。传统上用于数据保护,在泛在互联环境下也可作为一种知悉范围的控制机制,可在同一授权体系内用于隐私防护,但当信息离开该授权体系时不能提供延伸的访问控制。

【6】可信计算:通过可信基、可信执行环境、信任传递机制等构建可信系统,核心是保障计算环境的可信性和数据在计算过程中不被篡改。可信计算的本质是在可信系统范围内提供数据安全,当数据离开可信环境将无法保证数据安全。从隐私防护的角度,可信计算仅为隐私数据处理提供一个可信赖的计算环境。

【7】机密计算:在受信任的硬件执行环境基础上构建安全区域,所有参与方将需要参与运算的明文数据加密传输至该安全区域内并完成运算,安全区域外部的任何非授权的用户和代码都无法获取或者篡改安全区域内的任何数据。机密计算过程中的元数据不被计算参与方所获取,主要用于云计算场景下计算结果以明文或者机密性保护的方式交换。机密计算可在可信硬件执行环境下实现隐私防护,但当数据离开可信硬件执行环境时无能为力,仅适用于云计算等特定场景下的隐私防护。

【8】密文计算:是指计算过程中的数据不被计算参与方所获取,主要用于外包计算场景。同态加密是密文计算的代表性技术,是在事先确定转换规则的前提下,所有参与运算的明文数据使用该规则转换为密文,在密文空间中进行特定形式的代数运算并得到结果,密文运算的结果再通过相应的转换规则转换为明文运算结果,该结果与明文运算结果一致。本质上密文计算参与运算的明文及明文结果都没有信息损失,因此密文计算仅可用于计算过程中的隐私防护。

【9】安全多方计算:在事先确定参与方数目范围及交互协议的前提下,所有参与方以密文形式交互参与运算的信息并完成预先约定的运算任务,所有参与方都能得到运算结果的明文,但不能得到相互交互参与运算的明文信息。安全多方计算是无中心的计算架构,在有恶意参与者的情况下,诚实参与者仍能得到正确的结果,并且不泄露敏感信息。现阶段参与方的数目一般是两方和三方比较常见。秘密共享和不经意传输协议是构造安全多方计算协议的重要机制。本质上安全多方计算没有信息损失,适合于参与方较少场景下的隐私防护,但不适合于参与方高动态变化场景下的隐私防护。

【10】可算不可识:在 AI 和大数据应用中通常需要使用大量数据,但并不关心某个人的具体信息,可算不可识的目标是去标识化,原始数据不受损失,也不对敏感属性进行脱敏,因此可算不可识是隐私计算的一种应用需求,但并不能代替隐私计算。

【11】可用不可见:指泛在互联环境下用户可以得到数据计算的结果,但不能获取原始数据。可使用机密计算、密文计算、安全多方计算、“数据不动程序动”等技术或机制实现,属于数据安全的应用需求,而原始数据不出域是访问控制的研究范畴,可用于隐私防护。

【12】联邦学习:是多方利用自身拥有数据完成机器学习模型训练的一种分布式架构,合作方之间交换训练中间结果和模型参数,而不交换数据本身,自然而然减少了数据泄露,联邦学习的中间结果也会泄露数据的部分信息。因此,联邦学习是 AI 训练模型的一种模式,对隐私保护而言它仅是一种应用场景。

【13】隐私增强计算:Gartner 发布的 2021年前沿科技战略趋势[1]中提到了隐私增强计算,但我们认为其命名并不妥当,隐私保护的根本目的是不能让隐私本身增强,但“隐私增强计算(Privacy Enhancing Computation)”的中英文词义顾名思义应理解为隐私的增强计算技术,相应地应属于挖掘隐私信息的技术领域,即使隐私特征信息更加凸显出来。我们认为,若要表达用于隐私保护的技术,建议称为“隐私降低计算(Privacy ReducingComputation )” 或 “ 隐私保护能力增强 ( Capability Enhancing for PrivacyPreservation)”的计算技术才更为恰当。

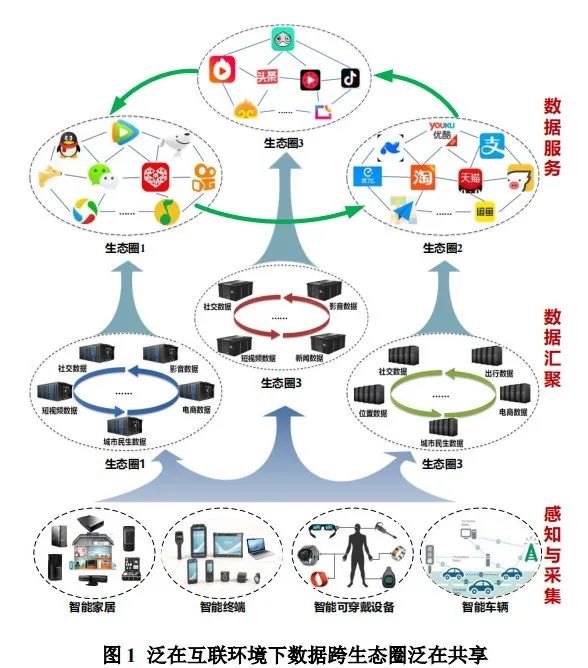

综上,我们梳理隐私、个人信息、数据、数据安全、隐私防护和隐私脱敏等概念之间的关系,如图 2 所示。其中,安全多方计算、同态加密、可信计算、密文计算、访问控制等技术是属于数据安全范畴,也可用于隐私防护,仅适用于特定知悉范围内没有信息损失的敏感信息保护。隐私脱敏是面向泛在互联环境下隐私信息泛在共享的隐私保护需求,是按照隐私保护的需求对隐私信息进行适当的损失以保护个人权益。隐私计算是针对泛在互联环境下隐私信息共享的全生命周期隐私保护和管控的理论和方法。

12.2.2.隐私计算内涵

12.2.2.1.隐私计算的定义

隐私计算的核心思想是支撑隐私信息的感知量化,建立隐私信息操作过程中的可计算模型,刻画隐私操作组合时隐私分量的量化演变规则、隐私保护算法能力评估、保护效果量化、隐私传播控制及其相互之间的映射关系,确定不同约束下能达到的最优隐私保护效果以及实现最优效果的隐私保护算法及其组合。隐私计算的最终目标是隐私保护的自动化执行,构建支持海量用户、高并发、高效能隐私保护的系统设计理论与架构,实现不同算法之间的有效组合。隐私计算的定义为[2]:隐私计算是面向隐私信息全生命周期保护的计算理论和方法,是隐私信息的所有权、管理权和使用权分离时隐私度量、隐私泄露代价、隐私保护与隐私分析复杂性的可计算模型与公理化系统。具体是指在处理视频、音频、图像、图形、文字、数值、泛在网络行为信息流等信息时,对所涉及的隐私信息进行描述、度量、评价和融合等操作,形成一套符号化、公式化且具有量化评价标准的隐私计算理论、算法及应用技术,支持多系统融合的隐私信息保护。隐私计算涵盖了信息搜集者、发布者和使用者在信息产生、感知、发布、传播、存储、处理、使用、销毁等全生命周期过程的所有计算操作,并包含支持海量用户、高并发、高效能隐私保护的系统设计理论与架构。隐私计算是泛在互联环境下隐私信息保护的重要理论基础。

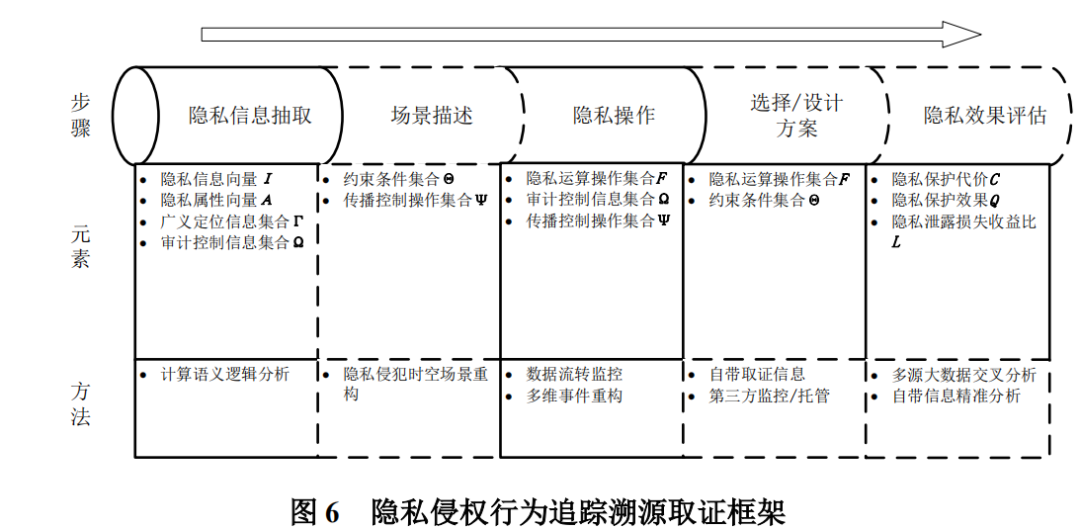

12.2.2.2.隐私信息的形式化描述

信息 M 可以是文本、图像、语音、视频等一种模态数据或者几种模态数据的混合数据。信息 M 中包含的隐私信息 X 用六元组表示,其中I代表隐私信息向量,其分量表示信息 M 中语义上含有信息量的、不可分割的、彼此互不相交的原子隐私信息;A 代表隐私属性向量,其分量表示隐私属性分量,用于量化隐私信息分量及分量组合的敏感度。在实际应用时,不同场景下的不同隐私信息分量可进行加权动态组合,这些组合会产生新的隐私信息,将不同隐私信息分量组合的隐私信息敏感度也作为扩展的隐私属性分量,因此隐私属性分量的数目多于隐私信息分量的数目;Γ代表广义定位信息集合,表示隐私信息分量在信息 M 中的位置信息及属性信息,可对隐私信息分量快速定位; Ω代表审计控制信息集合,表示隐私信息分量在传播过程中一个具体的审计控制向量,用于记录隐私信息分量在流转过程中的主客体信息和被执行的操作记录,当发生隐私信息泄露时,可进行追踪溯源。Θ代表约束条件集合,表示隐私信息分量对应的约束条件向量,用于描述在不同场景下实体访问对应隐私信息分量所需的访问权限;Ψ代表传播控制操作集合,用于描述隐私信息分量及其组合可被执行的操作,例如复制、粘贴、转发、剪切、修改、删除等操作,这些操作不破坏I的原子性。

12.2.3.隐私计算研究范畴

12.2.3.1.隐私计算关键技术环节

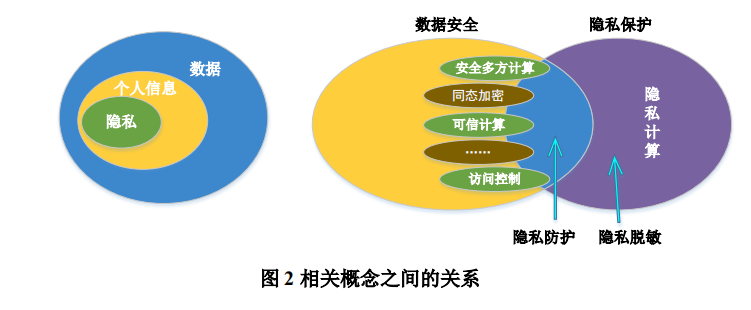

为了能够自动地对不同场景、不同类型的隐私信息进行差异化保护,需要构建出清晰的、软硬件高效实现的隐私计算框架,包括隐私信息的感知、隐私化、存储、融合、交换和销毁等关键技术环节。隐私计算所涵盖的 6 个环节的关系如图 3 所示,可指导隐私信息保护系统的实现。

【1】感知:在感知环节主要关注隐私描述规约、隐私分量判定、分类与分级量化。在隐私描述与规约机制方面,需要解决隐私元数据提取、隐私标记和编码、隐私的描述、隐私信息变化过程、推理规则等;在隐私分量判定、分类分级量化方面,在给定一个或多个数据文档的情况下,判定是否存在隐私,以及隐私分量的量化度量。所设计的隐私计算模型需要具备对主体、时间、空间三维演化的刻画能力。

【2】隐私化:隐私化环节主要关注脱敏机制、算法保护能力的评价理论和方法等问题。在脱敏机制方面,研究如何构造适用于隐私保护、与传统数据加解密不同的脱敏操作,k-匿名、混淆、泛化、抑制、解耦、加扰、差分隐私等都可作为大规模隐私保护信息系统的局部组件;在算法评价理论和方法方面,需综合判定和评价所选用的隐私保护算法是否满足相应的保护需求、是否具备对抗关联分析能力等方面要素,并给出相应的评价标准理论和方法。

【3】隐私信息存储:存储环节主要关注同质隐私信息去冗、隐私感知的混合数据分割存储、单副本的多用户完整性校验等问题,支持远程访问和细粒度访问的新型访问控制机制、局部数据修改和群修改的新型访问控制机制,以支撑隐私保护删除权、被遗忘权的落地实现。

【4】隐私信息融合:融合环节主要关注隐私信息匹配、隐私信息变换和隐私属性衍生、约束条件映射、隐私操作和隐私保护方案的自适应选择等问题。

【5】隐私信息交换:交换环节主要关注延伸访问控制机制、隐私动态调整、隐私侵权行为的判定和溯源取证等问题,通过延伸授权解决二次分发问题。

【6】隐私信息销毁:销毁环节主要关注删除指令通知机制、隐私信息的确定性完备删除等问题。确定性删除需保证隐私化后的信息不能去隐私化,且在接收到用户要求删除指令或者与用户约定信息存储到期后自动删除。建立通知消息机制和一套通知关联系统,通知其他隐私信息控制者和处理者删除隐私信息,释放存储空间。

12.2.3.2.隐私计算框架

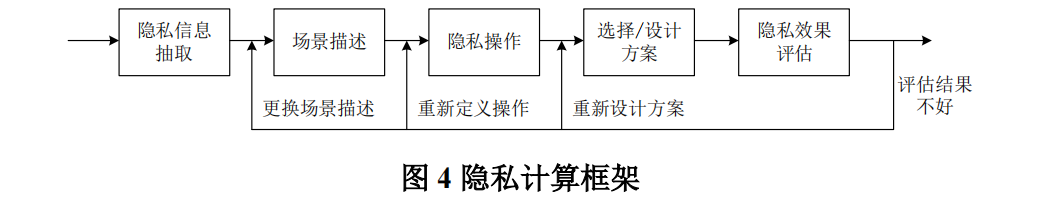

隐私计算框架是在隐私信息全生命周期的各个环节中建立应用场景、保护需求与计算模型之间的映射关系。基于场景描述和保护需求,适应性地选择相应环节的计算方法实现相应的计算功能。从全生命周期的角度出发,隐私计算框架如图 4 所示。

该框架面向任意格式的明文信息 M,具体包括以下 5 个步骤。

【1】隐私信息抽取:根据明文信息 M 的格式、语义等,抽取隐私信息并得 到隐私信息向量 I 。

【2】场景抽象:根据 I 中各隐私信息分量的类型、语义等,对应用场景进 行定义与抽象。

【3】隐私操作选取:选取各隐私信息分量所支持的隐私操作,并生成传播 控制操作集合。

【4】隐私保护方案设计/选取:根据需求选择/设计合适的隐私保护方案。如 有可用且适合的方案及参数,则直接选择;如无,则重新设计。

【5】隐私保护效果评估:根据相关评价准则,使用基于熵或基于失真的隐 私度量来评估所选择的隐私保护方案的隐私保护效果。

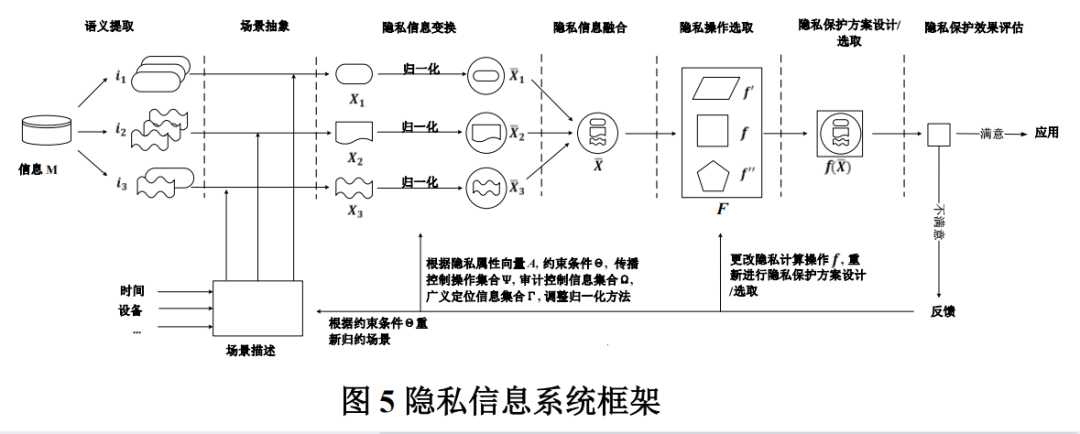

12.2.3.3.隐私信息系统框架

隐私信息系统框架包括语义提取、场景抽象、隐私信息变换、隐私信息融合、隐私操作选取、隐私保护方案设计/选取、隐私保护效果评估等环节,隐私信息系统框架如图 5 所示。

12.3. 隐私计算主要研究进展

12.3.1. 隐私计算理论的研究进展

12.3.1.1.隐私计算理论的提出

2015 年 12 月初,在北京首农香山国际会议中心讨论隐私保护相关技术时,中国科学院信息工程研究所李凤华研究员在国内外首次提出将隐私保护相关研究上升到理论体系,强调隐私保护是一种应用需求,而隐私计算才能代表一个理论体系,为了进一步明确隐私计算的内涵,李凤华给出了 2.2.1 节所述的隐私计算定义,并于 2016 年 4 月,联合李晖、贾焰、俞能海、翁健教授[2]在《通信学报》发表“隐私计算研究范畴及发展趋势”,正式发布了隐私计算的概念、学术内涵和研究范畴。同年,该论文被列入由中国密码学会组编的《中国密码学发展报告(2016-2017)》的 4 项年度成果之一。

12.3.1.2.隐私计算理论研究的深入

2019 年 3 月,李凤华、李晖等人[3]在中国工程院院刊《Engineering》上发表了“Privacy Computing: Concept, Computing Framework, and Future Development Trends”,从信息采集、存储、处理、发布(含交换)、销毁等全生命周期的各个环节角度出发,阐明了现有常见应用场景下隐私保护算法的局限性,提出了隐私计算理论及关键技术体系,其核心内容包括:隐私计算框架、隐私计算形式化定义、隐私计算应遵循的四个原则、算法设计准则、隐私保护效果评估、隐私计算语言等内容,并以四个应用场景为示例描述了隐私计算的普适性应用。2021 年 4 月,李凤华、李晖、牛犇[4]撰写了隐私计算方面的首部学术专著《隐私计算理论与技术》,并由人民邮电出版社正式出版发行。该专著针对泛在互联环境下的体系化隐私保护需求,高度凝练并系统介绍了隐私计算研究范畴、理论及其关键技术,并深入浅出地阐述了为什么要研究隐私计算、什么是真正的隐私计算、如何研究隐私计算、隐私计算成果如何落地,以及隐私计算如何演化发展。隐私计算得到了学术界的共识和认可,隐私计算研究被列入“十四五”国家重点研发计划“网络空间安全治理”重点专项 2021 年度项目申报指南的基础前沿技术类。

12.3.2.隐私计算技术的研究进展

12.3.2.1.隐私感知与度量

【1】隐私信息智能感知:隐私信息的智能感知是针对多模态数据形成隐私信息描述中的隐私信息分量,针对不同类型的数据需要使用相应的方法和工具。例如,针对文本数据,可以使用自然语言处理方法将文本分割为最小粒度;针对图像数据,可以采用图像理解算法识别图像数据中包含的语义。在此基础上,基于隐私智能感知算法,识别其中包含的隐私信息分量。隐私信息的智能感知可以通过预先构建的隐私识别模板或者隐私知识图谱匹配来实现。要保证隐私信息感知的准确率,则需要重点研究隐私知识图谱。因此隐私信息感知更多的是借鉴自然语言处理、图像理解、知识图谱等方面的研究成果。

【2】分类分级:在数据分级分类与隐私信息识别方面,2004 年 NIST 发布了《FIPS 199 联邦信息和信息系统的安全分类标准》,从信息的机密性、完整性和可用性三个角度进行低、中、高三个等级的评定。2015 年,NIST 发布了 SP 1500-2《NIST 大数据互操作性框架:第二卷,大数据分类法》,提出了基于大数据参考架构(NBDRA)的角色样本分类体系,将每个元素分解成多个部分,提供了特定粒度数据对象的描述以及属性、特征和子特征。在国内,与个人敏感信息相关的分类分级标准包括:GB/T 37964-2019 《信息安全技术个人信息去标识化指南》、GB/T 35273-2020《信息安全技术 个人信息安全规范》、JR/T 0171-2020《个人金融信息保护技术规范》、GB/T 38667-2020 《信息技术 大数据 数据分类指南》颁布实施;《信息安全技术 个人信息安全影响评估指南》《信息安全技术个人信息安全工程指南》展开编制;GB/T 37988-2019 《信息安全技术 数据安全能力成熟度模型》颁布实施,为数据安全能力的评估提供标准。

【3】敏感信息识别:李凤华等人[5]针对社交网络照片分享场景提出了一种照片隐私感知的方案SRIM(Social Relation Impression-Management)。照片中含有用户身份、位置、关系等隐私信息,分享照片可能会造成隐私泄露。SRIM 利用关系印象评估算法评估欲展示图片中的社交关系,并根据历史信息将图片接收者划分为推荐和不推荐展示两个类别,该方法不仅可以防止用户社交关系隐私信息的泄露,还可以自动推荐合适的图片分享策略。

基于分类分级标准,国内外已有部分厂商尝试利用自动化方法识别敏感数据。Amazon 公司发布了 Macie 通过机器学习和模式匹配识别 AWS 中的敏感数据。深信服智能数据分类分级平台引入了人工智能与机器学习算法,实现对数据进行多维度元数据特征向量自动提取,对相似字段数据进行聚合归类;华为云数据安全中心支持敏感数据快速识别。

12.3.2.2.隐私脱敏算法

隐私脱敏算法是隐私计算框架中按需脱敏的重要环节。当前隐私脱敏算法理 论主要有针对标识符的匿名化技术和差分隐私技术。

12.3.2.2.1. 匿名化脱敏技术

在发布数据时如果不加保护的发布原始数据,会导致严重的隐私信息泄露问题。数据记录的属性一般分为三类:显式标识符属性、准标识符(Quasi-Identifier, QI)属性、敏感属性。显式标识符属性可唯一标识单一自然人的属性,如身份证号码、姓名等;准标识符属性联合起来能唯一标识一个自然人的多个属性,如邮编、生日、性别等属性联合起来可能构成准标识符;敏感属性包含自然人隐私数据的属性,如健康状况、薪酬、兴趣爱好等。匿名化脱敏的目标是设法阻止每条记录中的敏感属性与显式标识属性相链接,避免个体的敏感属性值的泄露,同时要保留敏感属性的值,以供数据的使用者对进行数据挖掘和统计分析。典型的匿名化脱敏方法包括:

【1】泛化:将某一属性值用更一般的属性值来替代。聚类是一种特殊的泛化,它将表中的 n 条记录划分至 m 个不同聚类,每个聚类中的点数不少于 k 个。

【2】数据扰动:通过加噪、数据置换、人工数据合成等方法对原始数据进行一定的修改,但保留原始数据的统计信息。加噪用于数值型隐私数据;数据置换是指交换记录的隐私属性值;人工数据合成即依据现有数据构建一个统计模型, 然后从模型中抽样来构造合成数据以代替原始数据。

【3】抑制:用特殊符号代替现有属性以使得现有属性值更为模糊的匿名方法,如将手机号码写作 159****9468 以实现匿名。

【4】去耦:其不改变准标识符属性值和隐私属性值,而是将两者分开至两个独立的表中,这样,虽然数据不发生改变,但原有数据挖掘方法将不再适用。

【5】k-匿名[6]:由 Latanya Sweeney和

Pierangela Samarati在1998提出,它通过混淆数据的准标识符属性,可以在保证数据的实际可用性的条件下,保证其中的个体身份不会被恢复出来。因为k-匿名中不包含任何的随机化属性,其容易遭受背景知识攻击和同质攻击。同质攻击指如果一个匿名后等价类的所有个体的敏感属性都相同,如果攻击者知道某个用户在这个等价类中,就能推断出该用户的敏感属性。

【6】l-多样性:针对 k-匿名的同质攻击,Machanavajjhala 等人[7]在 2007 提出了一个改进的方案 l-多样性,使一个等价类中最少有 l个不同的敏感属性值。但是,l-多样性也并不能完全的保护用户隐私不被泄露,因为其只保证了多样性, 忽略了属性值上语义相近的情况。例如等价类中不同的敏感属性值为胃炎、胃溃疡、胃癌等,那么至少可以知道数据的主体患有胃病。另外,针对 l -多样的偏义 攻击也可能引起隐私泄露。

比如,一个新冠肺炎疾病信息的数据集中某一等价类 内包含阳性和阴性人数各占 50%,从而满足 2-多样性,但我们知道正常数据集整 体抗体阳性和阴性比例分别占 1%和 99%。这样若知道某个个体在这个等价类中, 其有 50%的概率阳性,事实上已经发生了隐私泄露。

【7】t-邻近性:Li Ninghui 等人[8]在提出的 t -邻近方案弥补了 l-多样性, t -邻近指一个等价类中的属性分布和整个表中的属性分布之间的距离不超过门限 t。如果一个数据表中的每个等价类都满足 t-邻近,则称这个数据表满足 t -邻近。

12.3.2.2.2. 差分隐私脱敏技术

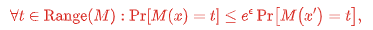

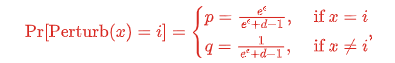

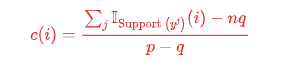

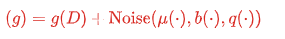

Dwork 等人[9]提出的差分隐私模型来自于密码学中语义安全的概念,即攻击 者无法区分出不同明文的加密结果。差分隐私模型不需要依赖于攻击者所拥有多 少背景知识,而且对隐私信息提供了更高级别的语义安全。李凤华等人[3]提出了 基于差分的通用脱敏算法设计准则,包含以下步骤:

预处理:

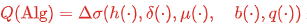

是 个满足 的算法, 是 个不相交的数据集, 则

是 个满足 的算法, 是 个不相交的数据集, 则 满足 -DP 。

满足 -DP 。 来刻画。

来刻画。12.3.2.2.3. 本地化差分隐私机制